Certyfikacja systemów AI to złożony proces, który obejmuje zarówno regulacje dotycząc AI, jak i regulacje branżowe. W szczególności rozporządzenie AI Act (EU 2024/1689) definiuje pojęcie systemów wysokiego ryzyka, dla których zostały określone dodatkowe wymagania. Dla tak złożonego procesu, zastosowanie assurance case daje możliwość efektywnego zarządzania rozwojem systemu dla jego certyfikacji.

AI Act definiuje systemy wysokiego ryzyka trochę inaczej, niż przywykliśmy w dziedzinie systemów krytycznych, bo oprócz systemów mających wpływ na zdrowie ludzi i infrastruktur krytycznych, są tu też systemy mające wpływ na prawa podstawowe w UE, pracę, dostęp do usług, wymiar sprawiedliwości czy procesy demokratyczne. Zastosowanie AI w systemie medycznym, na przykład diagnozowania obrazowego, jest typowym przykładem systemy wysokiego ryzyka w rozumieniu AI Act. Jest to system krytyczny, będący przedmiotem regulacji i standardów dotyczących bezpieczeństwa wyrobów medycznych.

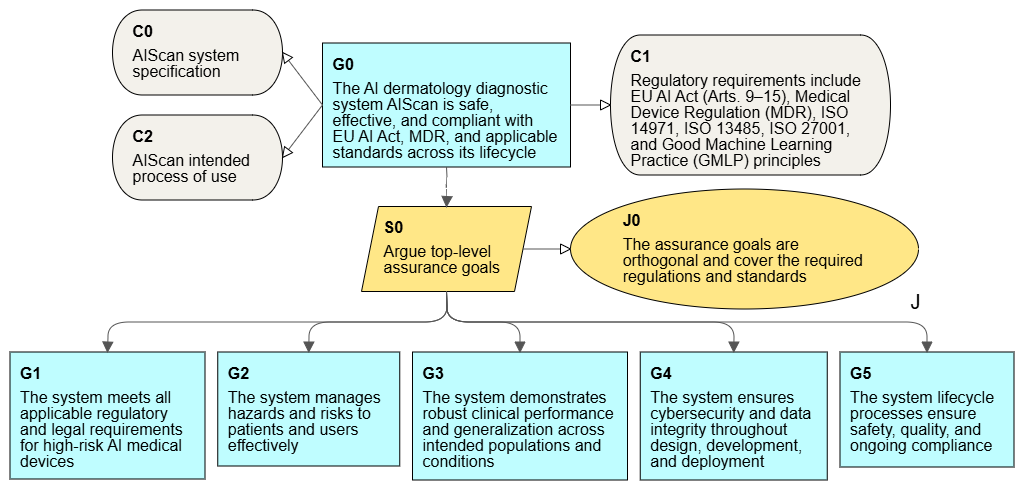

Wymagania certyfikacji

Aby porozmawiać o zastosowaniu assurance case dla takiego systemu musimy zacząć o określenia zakresu wymagań formalnych.

- Taki system spełnia kryteria systemu wysokiego ryzyka w rozumieniu AI Act, który określa też wymagania na certyfikację zgodności przed dopuszczeniem do użytkowania.

- ISO 13485 to podstawowy wymóg po stronie kwalifikacji systemów medycznych. Standard określa wymagania na system zarządzania jakością, co jest też wymagane przez AI Act.

- Kolejny wymagany standard branżowy to ISO 14971 dotyczący zarządzania ryzykiem dla wyrobów medycznych. Zarządzanie ryzykiem jest też wymagane w AI Act dla systemów wysokiego ryzyka.

- Nie możemy też zapominać o rozporządzeniu MDR (EU Medical Device Regulation 2017/745) dla wyrobów medycznych.

Przeglądając AI Act znajdziemy też wymagania cyberbezpieczeństwa, gdzie nie ma wprost wymagania stosowania ISO 27001, ale w tym standardzie znajdziemy wymagane zabezpieczenia.

Bardziej szczegółowa analiza może zidentyfikować więcej standardów, ale przedstawiona grupa zapewnia dobrą bazę do prac nad systemem AI i przygotowaniem do jego certyfikacji. Mamy więc dosyć szeroki zakres procesu i dokumentacji, które podlegają ocenie dla akceptacji systemu. Punktów niezależnej oceny jest kilka, w tym ocena wiarygodności klinicznej, audyty systemu zarządzania jakością (QMS), a na koniec ocena zgodności systemu dla AI Act i MDR.

Certyfikacja systemu nie jest końcem, a punktem przejściowym do fazy użytkowania systemu. Mamy wtedy audyty post-market, w szczególności po wystąpieniu incydentów. A co bardziej istotne dla systemów AI, dla każdej nowej wersji, jeżeli model AI jest modyfikowany, wymagana jest ponowna certyfikacja, o ile certyfikacja nie obejmuje ciągłego uczenia się. To wszystko razem tworzy potrzebę silnego zarządzania spójnością całości dokumentacji oraz kontroli zmian i wersjonowania. Assurance case może być centralnym punktem tych prac.

Główne korzyści zastosowania assurance case dla takiego systemu to przede wszystkim:

- Efektywność procesu przygotowań i samej certyfikacji dzięki systematyczności podejścia i przejrzystości zapewnianej przez argumentację

- Obniżenie ryzyka dzięki sprawniejszemu i wcześniejszemu wykrywaniu luk i niezgodności

- Jednolite raportowanie dla wszystkich obszarów systemu przez cały czas życia systemu

- Łatwiejsza interakcja z audytorami i instytucją certyfikującą

Sprawność budowy wersji assurance case dla nowych wersji systemu, szczególnie przy automatyzacji argumentacji w pipeline CI/CD

Od czego zacząć?

Certyfikacja czy kwalifikacja systemów często w praktyce obejmuje wiele regulacji i standardów. Tak jest też w przypadku tego systemu. Pierwsze decyzje dotyczą zwykle organizacji procesu assurance case oraz architektury argumentacji. Dobrze, gdy te działania rozpoczynają się wcześnie, na etapie koncepcji systemu. Pomocne są być szablony argumentacji, w szczególności obejmujące zintegrowany zbiór wymagań mających zastosowanie regulacji i standardów.

Zakres wymagań certyfikacji obejmuje wymagania bezpieczeństwa, ale też specyficzne dla technologii AI. Główne wymagania dotyczą dokładności i czułości modeli dla minimalizacji błędów fałszywie pozytywnych i negatywnych oraz walidacja kliniczna. To dotyczy wprost zastosowania w medycynie, ale są też wymagania dotyczące wprost specyfiki AI, na przykład uprzedzeń, interpretowalność, czyli możliwość wyjaśnienia decyzji. Pełna dekompozycja wymagań tworzy złożony szablon argumentacji, który można te dostosowywać do danego systemu i jego specyfiki.

Zastosowanie assurance case daje dobry poziom kontroli procesu na każdym etapie i pozwala obniżyć ryzyko.